Resumen:

La retroalimentación efectiva sobre los trabajos para lograr mejoras de los resultados de aprendizaje de los estudiantes es importante; sin embargo, no siempre se logra dicho propósito. En este contexto, para la presente investigación se diseñó la retroalimentación efectiva mediante inteligencia híbrida, combinando la inteligencia artificial (IA) y la humana, con el fin de responder a los tres interrogantes clave del modelo propuesto por Hattie & Timperley: ¿Dónde estoy? ¿Hacia dónde voy? y ¿Cómo llegar allí? El objetivo fue medir el efecto de la retroalimentación generada con inteligencia híbrida sobre el rendimiento académico y la satisfacción de los estudiantes de una universidad peruana de educación a distancia. La metodología utilizada fue experimental, los resultados demostraron una mejora del 19 % del rendimiento académico y un 9 % de incremento de la satisfacción en los estudiantes del grupo experimental.

Palabras clave:

educación a distancia; inteligencia artificial; inteligencia híbrida; inteligencia humana; retroalimentación efectiva

Abstract

Effective feedback on student work is important for achieving improvements in learning outcomes; however, this goal is not always attained. In this context, the present study designed effective feedback using hybrid intelligence, combining artificial (AI) and human intelligence, in order to address the three key questions of the model proposed by Hattie & Timperley (2007): Where am I? Where am I going? How do I get there? The objective was to measure the effect of feedback generated with hybrid intelligence on the academic performance and satisfaction of students at a Peruvian distance education university. The methodology used was experimental, and the results showed a 19% improvement in academic performance and a 9% increase in satisfaction for students in the experimental group.

Keywords:

distance education; artificial intelligence; hybrid intelligence; human intelligence; effective feedback

1. Introducción

El estudio tuvo como objetivo buscar una forma efectiva de brindar retroalimentación a estudiantes de educación superior universitaria en educación a distancia, el mismo que presentó oportunidades de mejora tras analizar algunos casos en los que la retroalimentación sobre los resultados obtenidos era insuficiente y que tenían poca coherencia con las calificaciones, así como el incremento de reclamos por los estudiantes al no estar satisfechos con la información recibida de sus docentes.

El objetivo general de la investigación fue determinar si había diferencias significativas en las variables dependientes de rendimiento académico y satisfacción entre el grupo de estudiantes que recibió retroalimentación efectiva y el que recibió retroalimentación tradicional. En coherencia con el objetivo, las preguntas que orientaron la investigación fueron:

P1: ¿Existen diferencias significativas en el rendimiento académico entre los estudiantes que reciben retroalimentación efectiva e híbrida y aquellos que reciben retroalimentación tradicional en educación a distancia?

P2: ¿Existen diferencias significativas en la satisfacción estudiantil entre ambos grupos de estudiantes?

La investigación es un estudio de caso, por lo que sus resultados no pueden ser generalizados a otros contextos o realidades, pero sería un punto de partida comparable para futuras investigaciones. El estudio fue de diseño experimental y de corte transversal y tuvo como unidad de análisis a estudiantes de educación a distancia de la Universidad Continental de Perú. La muestra fue aleatoria y aplicada a dos grupos de una misma asignatura, transversal a varias carreras profesionales, y del tercer ciclo de estudios.

Se entiende por retroalimentación efectiva aquella que responde a las tres preguntas según el modelo de Hattie & Timperley (2007): ¿Dónde estoy? ¿Hacia dónde voy? ¿Cómo llegar allí?. Para el estudio fue diseñada mediante el uso de la inteligencia artificial, y potenciada o mejorada con inteligencia humana (inteligencia híbrida). Alvarado García (2014) refiere que una retroalimentación en educación a distancia «debe reflejar: observaciones, correcciones, aportaciones, reforzamiento y una evaluación cuantitativa basada en una rúbrica, y la puntual descripción de la actividad» (p. 70). Por otra parte, para la investigación se entiende por retroalimentación tradicional aquella que no sigue una estructura y se centra, sobre todo, en los aciertos y desaciertos de los estudiantes; en cambio, la retroalimentación efectiva sigue una estructura con el enfoque de mejorar el resultado de aprendizaje de los estudiantes. Se plantea que la retroalimentación híbrida podría ser una alternativa eficaz para brindar retroalimentación a los estudiantes dado que permite un enfoque personalizado y humanizado, apuesto a los resultados mediante inteligencia artificial.

2. Revisión de la literatura

La retroalimentación en entornos virtuales desempeña un papel central tanto en el rendimiento académico como en la satisfacción del estudiante. En contextos de educación a distancia su valor pedagógico adquiere mayor relevancia, ya que esta modalidad no suele producirse en tiempo real. Por esta razón, su diseño debe ser lo más preciso y pertinente posible, de modo que logre reducir la brecha entre el aprendizaje actual y el deseado, para facilitar el desarrollo de competencias clave en los estudiantes. Estudios recientes señalan que, en ambientes de aprendizaje en línea, la retroalimentación que se caracteriza por su oportunidad, claridad de criterios y posibilidades de interacción (diálogo, seguimiento) favorece la autorregulación, la motivación y la persistencia del estudiante (Attiogbe et al., 2025; Öztürk et al., 2025). En particular, Attiogbe et al. (2025) identifican que cuando las estrategias de retroalimentación en educación a distancia se gestionan de forma adecuada (incluido seguimiento, adaptaciones al estudiante y comunicación constante), tienen un aporte significativo en el rendimiento académico. Estos hallazgos amplían los resultados provenientes del período pandémico, en los que se observó la necesidad de adaptar el diseño instruccional para mantener la calidad del feedback en contextos remotos.

Durante la pandemia de COVID-19, numerosas instituciones educativas enfrentaron importantes desafíos para implementar estrategias efectivas de retroalimentación. Un estudio realizado por Huayhua Prada et al. (2021) evidenció que la retroalimentación formativa, fundamentada en criterios claros y comunicación constante, favoreció el aprendizaje autónomo y la motivación estudiantil, incluso en medio de las limitaciones del entorno remoto. Del mismo modo, García Riveros et al. (2021) identificaron que uno de los mayores retos para los docentes en la educación a distancia es mantener una evaluación continua y significativa; los autores subrayan que la retroalimentación debe ser personalizada, pertinente y oportuna para generar un efecto positivo en los estudiantes. Más recientemente, Pentucci & Laici (2023) hicieron una encuesta en cursos universitarios italianos (post-covid) y encontraron que la percepción del estudiante sobre la relevancia y el seguimiento del feedback influyó directamente en su nivel de engagement y autorregulación. Estos trabajos confirman que, más allá de la herramienta empleada, lo esencial radica en diseñar procesos de retroalimentación que promuevan la reflexión y el aprendizaje activo, y se adapten a las características del entorno virtual.

La educación a distancia se caracteriza por la separación física entre el docente y el estudiante, lo cual es posible gracias al uso de tecnologías que facilitan la comunicación y el aprendizaje (Keegan, 2013). En este tipo de modalidad, un aspecto muy relevante es la evaluación y monitoreo de los aprendizajes, así como la retroalimentación para conocer el progreso de los estudiantes e implementar las acciones pedagógicas pertinentes a fin de mejorarlo (CEPAL-UNESCO, 2020). Por su parte, Lozano & Tamez (2014) sugieren que la educación a distancia exige que los estudiantes desarrollen habilidades de autoestudio, autocontrol y autorregulación, además de mantener la motivación por el aprendizaje continuo. Esta idea coincide con hallazgos recientes que muestran que la efectividad de la retroalimentación en educación a distancia está mediada por la competencia digital del estudiante, su experiencia previa con entornos en línea y su capacidad de autorregulación (Budiman, 2025; Espasa et al., 2022). Por ejemplo, Espasa et al. (2022) hallaron que la experiencia previa del estudiante, con retroalimentación en línea, influye en su grado de compromiso cognitivo con el feedback, en otras palabras, no solo importa qué se da, sino qué tan preparado está el estudiante para recibirlo. Esto sugiere que las intervenciones de retroalimentación deben considerar tanto al estudiante como al entorno tecnológico, desde una perspectiva de diseño instruccional.

La retroalimentación efectiva se puede definir como la información comunicada al estudiante con la intención de modificar su pensamiento o comportamiento para mejorar el aprendizaje (Shute, 2008). Esta definición se operacionaliza en el modelo de Hattie & Timperley (2007), quienes sostienen que la retroalimentación debe reducir la discrepancia entre las comprensiones actuales del estudiante y el desempeño esperado; para ello, estos autores proponen que la retroalimentación efectiva debe responder a tres preguntas clave: ¿A dónde voy? (metas) ¿Cómo voy? (progreso hacia la meta) ¿Qué sigue? (acciones para mejorar). De manera complementaria, Nicol & MacFarlane-Dick (2006), dentro de sus principios de buenas prácticas, plantean que la retroalimentación debe ayudar a clarificar qué se entiende por un buen desempeño, en materia de metas, criterios y estándares esperados. Entre los desarrollos recientes, Öztürk et al. (2025) muestran que la retroalimentación online, tanto de compañeros como de docentes, mejora la autorregulación, lo que sugiere que el feedback puede activar procesos metacognitivos cuando está vinculado a tareas relevantes y temporales. En conjunto, este cuerpo de evidencia sugiere que un buen diseño del feedback requiere garantizar claridad, temporalidad y fomentar la reflexión sobre el propio aprendizaje, y no solo la corrección.

La integración de inteligencia artificial generativa con analíticas de aprendizaje representa una convergencia prometedora para ofrecer retroalimentación personalizada. De acuerdo con esta perspectiva, Banihashem et al. (2025) argumentan que dicha combinación permite adaptar recomendaciones basadas en los patrones de comportamiento del estudiante, con lo que mantiene, al mismo tiempo, principios de responsabilidad y rendición de cuentas. Así, la retroalimentación no solo se torna más precisa, sino también más estratégica y alineada con objetivos pedagógicos. Complementariamente, Ba et al. (2025) hicieron una revisión sistemática sobre «AI-assisted feedback» y concluyeron que, si bien los sistemas de retroalimentación asistida por IA ofrecen velocidad y consistencia, su eficacia depende del tipo de tarea, del estudiante, del dominio y de la presencia de mediación humana. Esta necesidad de mediación lo evidencian también Lo et al. (2025), quienes compararon la retroalimentación humana, la automatizada y la híbrida, y encontraron que los modelos híbridos (humano más IA) generan mejoras superiores en escritura académica que los aportados solo por IA, lo que confirma que la mera automatización no sustituye el componente humano. En conjunto, estas evidencias consolidan la necesidad de considerar el diseño de la retroalimentación híbrida como estrategia clave en educación a distancia.

La implementación ética de la inteligencia artificial en contextos educativos requiere un marco normativo claro que garantice su uso responsable. En este sentido, Yan et al. (2023), en una revisión sistemática de modelos de lenguaje amplio (LLM) en educación, señalaron desafíos críticos como la transparencia, el sesgo, la privacidad y la justicia pedagógica. Estos desafíos también se reflejan en la percepción de los estudiantes; Kotlyar et al. (2025) mostraron que, aunque mejorar la credibilidad y la empatía en la retroalimentación automática puede reducir la brecha de aceptación entre el feedback generado por IA y el humano, dicha brecha persiste. Desde otra perspectiva, Kohnke et al. (2023) revelaron que numerosos docentes, aunque dispuestos a integrar IA generativa, expresan incertidumbre con respecto a su aplicación ética y pedagógica, lo que sugiere que la formación docente debe incluir tanto conocimientos técnicos como reflexión crítica. En conjunto, estos hallazgos resaltan que la adopción de retroalimentación híbrida requiere tanto un diseño pedagógico robusto como una gestión ética y formativa que acompañe su implementación.

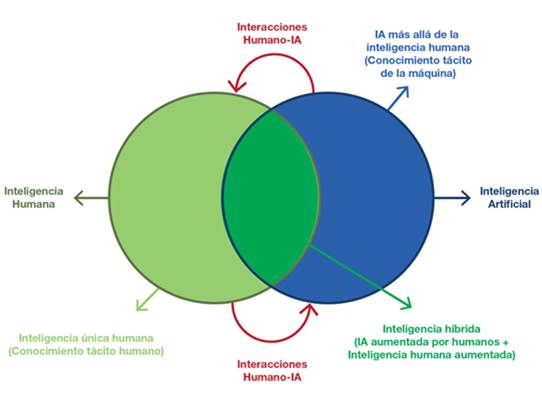

La inteligencia híbrida, entendida como la combinación de capacidades humanas y artificiales, se presenta como una estrategia eficaz para resolver problemas complejos y mejorar la toma de decisiones. Según Jarrahi et al. (2022), esta forma de inteligencia permite aprovechar lo mejor de ambos mundos, ya que integra la creatividad y el juicio humano con la precisión y la velocidad de las máquinas (ver Figura 1). Desde un enfoque más aplicado, Kong et al. (2025) proponen el modelo de sinergia IA-humano (HAI-SDM) y muestran que, en entornos educativos mixtos, la colaboración entre humanos y sistemas de IA aún se sitúa en niveles moderados, y su efectividad está condicionada por la estructura de la actividad, la alfabetización en IA y el entorno colaborativo. Esta sinergia resulta particularmente útil para diseñar retroalimentación académica al permitir una personalización más precisa y un análisis adaptativo del desempeño estudiantil.

Convergencia entre la inteligencia humana y la inteligencia artificial: inteligencia híbrida

La aplicación de herramientas como ChatGPT para retroalimentar textos argumentativos evidencia tanto fortalezas como limitaciones. En un estudio de caso, Wang et al. (2024) encontraron que, aunque el sistema ofrece observaciones útiles sobre la coherencia y organización del texto, suele omitir aspectos más complejos como el pensamiento crítico o el abordaje de contraargumentos. Esto sugiere que, si bien la IA puede ser una aliada valiosa, la intervención humana sigue siendo indispensable en tareas que exigen un procesamiento cognitivo profundo. De manera complementaria, Singh & Hiran (2022) documentaron que la retroalimentación personalizada mediada por IA puede mejorar de forma significativa el desempeño académico, especialmente cuando se combina con orientación humana. Asimismo, Yin et al. (2025) demostraron que los estudiantes expuestos a retroalimentación metacognitiva obtienen mejores resultados en la transferencia de conocimientos, mientras que quienes reciben retroalimentación afectiva muestran mayor retención de contenido en comparación con aquellos que reciben retroalimentación neutral. Estos estudios evidencian que la retroalimentación híbrida tiene un potencial superior a la realizada únicamente con herramientas de IA.

En síntesis, la retroalimentación efectiva generada con inteligencia híbrida en educación a distancia constituye un componente esencial del aprendizaje autónomo, ya que permite a los estudiantes identificar su situación actual, comprender los resultados de aprendizaje e implementar acciones para alcanzarlos. Para que esta retroalimentación sea significativa debe ser personalizada, oportuna y pertinente. En este contexto, la inteligencia híbrida se posiciona como una alternativa poderosa para agilizar el proceso y mejorar su calidad; además, al estar complementada con el juicio pedagógico del docente, garantiza una interacción más humana, contextualizada y orientada al desarrollo integral del estudiante.

3. Método

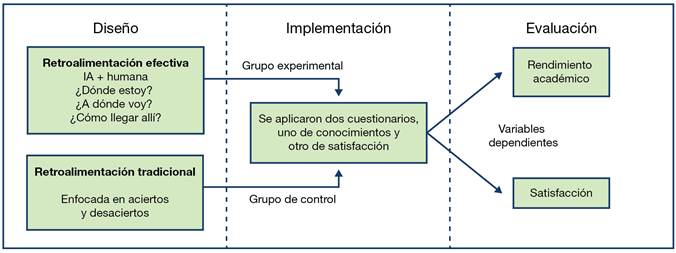

La investigación evaluó el efecto de la retroalimentación generada por IA y humana en el aprendizaje y la satisfacción de estudiantes universitarios en educación a distancia. Se utilizó un diseño experimental con dos grupos: uno experimental que recibió retroalimentación híbrida y otro de control con retroalimentación tradicional. Este tipo de diseño es adecuado para determinar relaciones causales entre variables mediante la manipulación deliberada del tratamiento y la asignación aleatoria (Hernández et al., 2014). Se esperaba que la retroalimentación híbrida mejorara el rendimiento académico y la satisfacción de los estudiantes, dado que varios estudios previos han señalado que una retroalimentación formativa, oportuna y específica tiene un impacto positivo en el aprendizaje (Hattie & Timperley, 2007; Shute, 2008).

El estudio se llevó a cabo en la Universidad Continental (Perú) con 25 estudiantes de la asignatura Laboratorio de Innovación, de la modalidad a distancia. Los estudiantes fueron asignados de manera aleatoria a los grupos experimental (12 estudiantes) y de control (13), para garantizar la equivalencia de los grupos y minimizar sesgos (Campbell & Stanley, 1963). El tamaño de la muestra estuvo sujeto a la cantidad de estudiantes matriculados en la asignatura y que dieron su consentimiento informado para participar del estudio; Dado que la muestra fue pequeña, los resultados son preliminares se y necesitan reproducir con una muestra más grande para poder generalizarlos. Los datos se recogieron mediante cuestionarios de conocimientos y satisfacción, previamente validados por juicio de expertos, a partir de procedimientos recomendados para garantizar la validez de contenido en estudios educativos (Escobar-Pérez & Cuervo-Martínez, 2008). Los cuestionarios fueron aplicados en línea mediante formularios de Google y de manera síncrona. El análisis de datos cuantitativos se realizó con la herramienta Stata, que permitió calcular la significancia de los resultados.

La intervención se basó en el modelo de retroalimentación de Hattie & Timperley (2007), con las preguntas: ¿Dónde estoy? (nivel actual) ¿A dónde voy? (logro de aprendizaje) y ¿Cómo llegar allí? (estrategias para mejorar). Este modelo ha sido ampliamente reconocido por su efectividad en mejorar el rendimiento cuando se implementa de forma estructurada (Wiliam, 2011). La retroalimentación de IA se generó con ChatGPT, una herramienta basada en modelos de lenguaje de gran escala (LLM) que ha demostrado ser útil en tareas de apoyo pedagógico en entornos digitales (Kasneci et al., 2023). Posteriormente, la retroalimentación fue revisada y mejorada con inteligencia humana, con el fin de garantizar la pertinencia pedagógica y la empatía comunicativa, elementos fundamentales en contextos educativos (Nicol & Macfarlane-Dick, 2006). La retroalimentación se brindó a los estudiantes de manera asíncrona en la plataforma del curso luego de evaluar una prueba con rúbrica.

Para el grupo de control se diseñó una retroalimentación tradicional (ver Tabla 1) enfocada en aciertos y desaciertos; a continuación se muestra ejemplo con uno de los criterios que se utilizó en la investigación; más adelante se muestra la retroalimentación híbrida con el mismo criterio que se aplicó al grupo experimental.

En las Tablas 2 y 3 se puede observar un ejemplo de mejora -potenciada con inteligencia humana en función de la retroalimentación inicial generada por IA- de un criterio de la rúbrica de evaluación aplicada en la prueba. Las mejoras fueron las siguientes:

-

Respecto al feedup o logro esperado, se estandarizó para todos los niveles de la rúbrica debido a que la IA generó logros de aprendizaje distintos para cada nivel, lo cual no fue pertinente al considerar que cada criterio persigue un solo objetivo.

-

Respecto al feedback o nivel actual, se agregaron expresiones afectivas y empáticas, tales como ¡Fenomenal!, ¡Lo hiciste bien!, hay un buen análisis, entre otros.

-

Respecto al feedforward o estrategias para mejorar, se profundizó en los aspectos metacognitivos, que pasaron de ser muy generales a ser mucho más detallados. Para ello se contextualizó con la tarea, se agregaron términos propios de la asignatura que la IA no había considerado en su propuesta de retroalimentación.

El procedimiento incluyó tres fases: diseño, implementación y evaluación de la intervención, con un enfoque de mejora cíclica orientado a la toma de decisiones basada en evidencia (McMillan & Schumacher, 2005). Finalmente, se evaluaron los resultados mediante análisis estadístico descriptivo e inferencial, al comparar las variables dependientes entre los grupos y determinar el efecto de la retroalimentación (ver Figura 2).

En la Tabla 4 se muestra la operacionalización de variables empleadas en la investigación.

4. Resultados

Para evaluar el supuesto de normalidad de las variables de rendimiento y satisfacción se aplicó la prueba de Shapiro-Wilk, recomendada para muestras pequeñas. Con los resultados se comprueba que ambas variables cumplen con el supuesto de normalidad (ver Tabla 5). En consecuencia, se optó por utilizar la prueba t para la variable rendimiento; y la prueba U (Mann-Whitney) para la variable satisfacción, dado que su p-valor es ligeramente superior al umbral de .05.

El rendimiento académico se evaluó mediante una prueba de conocimientos con una puntuación máxima de 20 puntos. Los resultados muestran que el grupo experimental obtuvo un promedio de 17.42, mientras que el grupo de control obtuvo una media de 14.62. La diferencia entre ambos grupos fue estadísticamente significativa, con un valor de t de -3.09 y un nivel de significancia menor a .01 (ver Tabla 6). Este resultado valida la hipótesis de que el grupo experimental tuvo un mejor rendimiento académico luego de recibir la retroalimentación efectiva.

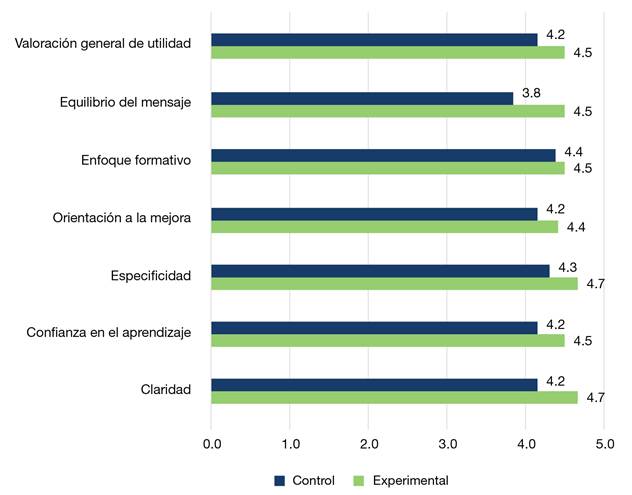

La satisfacción se midió mediante un cuestionario de salida con una escala de 1 a 5, en el que 1 representa totalmente en desacuerdo y 5 totalmente de acuerdo. El grupo experimental obtuvo un promedio de satisfacción de 4.54, mientras que el grupo de control obtuvo un promedio de 4.16. La diferencia entre los grupos fue estadísticamente significativa, con un valor de U (Mann-Whitney) de 42 y un nivel de significancia menor a .05 (ver Tabla 7). Por consiguiente, se valida la hipótesis de que el grupo experimental tuvo una mayor satisfacción que el grupo de control.

Las dimensiones que obtuvieron puntuaciones más elevadas fueron las de equilibrio del mensaje, claridad y especificidad. Se entiende por equilibrio del mensaje cuando consideran que la retroalimentación recibida señala tanto las fortalezas como las áreas de mejora; con respecto a la dimensión claridad, se refiere a cuando el mensaje ayudó a comprender claramente qué se espera de la tarea; mientras que la dimensión especificidad permite identificar exactamente en qué aspectos debía mejorar (ver Figura 3).

5. Discusión y conclusions

El objetivo de la investigación fue medir el efecto de una retroalimentación generada con inteligencia híbrida sobre el resultado de aprendizaje y satisfacción de los estudiantes universitarios. Los resultados muestran que el uso de inteligencia híbrida para proporcionar retroalimentación efectiva en un ambiente de educación a distancia es una estrategia eficaz para mejorar el aprendizaje, especialmente cuando se combina con mediación humana (Lo et al., 2025; Singh & Hiran, 2022). Estos hallazgos respaldan el modelo de Hattie & Timperley (2007) como marco para diseñar una retroalimentación efectiva, en línea con autores como Shute (2008), Nicol & MacFarlane-Dick (2006) y Öztürk et al. (2025), quienes destacan que la retroalimentación debe clarificar metas, progreso y pasos futuros. Además, hay que considerar que la retroalimentación -al ser parte del proceso formativo- debe reforzar el pensamiento crítico, la autorregulación, la motivación y el aprendizaje autónomo, así como estar basada en criterios claros y mantener comunicación constante (Attiogbe et al., 2025; Espasa et al., 2022; Huayhua Prada et al., 2021). Sin embargo, su efectividad depende de factores como la competencia digital del estudiante, la mediación docente y la adecuación al tipo de tarea (Budiman, 2025; Lo et al., 2025). Para García Riveros et al. (2021), el mayor reto en educación a distancia es mantener una evaluación continua y significativa, lo que implica que la retroalimentación debe ser personalizada, pertinente y oportuna.

Como respuesta a la primera pregunta de investigación, se concluye que hay diferencias significativas en el rendimiento académico entre los estudiantes que recibieron retroalimentación efectiva e híbrida, frente a los que recibieron retroalimentación tradicional en educación a distancia. El grupo experimental que recibió retroalimentación basada en IA y potenciada por inteligencia humana logró una puntuación media mayor en 2.8 puntos, 19 % mayor frente al rendimiento del grupo de control que recibió una retroalimentación tradicional enfocada principalmente en los aciertos y desaciertos, y sin ofrecer una retroalimentación clara del aprendizaje esperado y de cómo mejorar. Tal diferencia de rendimiento concuerda con estudios previos como los de Singh & Hiran (2022), Yin et al. (2025), y Wang et al. (2024), quienes demostraron que la integración de IA con orientación docente mejora la comprensión y el desempeño académico en especial cuando se combina con elementos metacognitivos y afectivos. Asimismo, estos resultados respaldan la teoría de Jarrahi et al. (2022), Lo et al. (2025), y Kong et al. (2025), quienes señalan que la inteligencia híbrida combina creatividad humana con la precisión artificial para personalizar la retroalimentación y optimizar el aprendizaje.

Como respuesta a la segunda pregunta de investigación se concluye que existen diferencias significativas de la satisfacción estudiantil entre los estudiantes del grupo experimental y los de control. Los hallazgos demostraron que la retroalimentación híbrida generó una satisfacción de un 9 % más alta en el grupo experimental. Este resultado se debió principalmente a que permitió que los estudiantes identificaran aspectos de mejora, fortalecieran su aprendizaje continuo, comprendieran con claridad los criterios de evaluación, y reflexionaran sobre su desempeño actual. En esta conclusión no se identificaron estudios previos sobre la satisfacción, en específico bajo un modelo de inteligencia híbrida en la retroalimentación efectiva, por lo que se sugiere incluir esta variable en futuras investigaciones.

La limitación principal del estudio fue el tamaño muestral; si bien los resultados de la investigación son alentadores deben considerarse como preliminares, por lo que no pueden generalizarse. Para ello se requiere una muestra más amplia en la que incluso se calcule la potencia estadística para obtener resultados concluyentes. Además, la investigación no evaluó la eficacia de la retroalimentación generada exclusivamente por IA, lo que constituye una limitación específica del diseño experimental. Los estudios previos indican que, aunque la IA puede ofrecer retroalimentación personalizada y empática, su efectividad depende tanto de la mediación humana como de la percepción y aceptación del estudiante (Kotlyar et al., 2025). En consecuencia, las futuras investigaciones podrían explorar si la retroalimentación generada únicamente con IA puede alcanzar resultados comparables a los obtenidos mediante la inteligencia híbrida.

Finalmente, se identifican tareas pendientes que podrían incluirse en futuras investigaciones en tales como profundizar en los desafíos éticos asociados al uso de la IA en educación, particular relacionadas a la transparencia, el sesgo, la privacidad y la justicia pedagógica (Yan et al., 2023), y fortalecer la preparación docente en aspectos técnicos y éticos para una integración responsable de la IA en la retroalimentación (Kohnke et al., 2023).

Agradecimientos y reconocimientos

Agradecemos a la Universidad Continental por su constante esfuerzo en promover la investigación y el desarrollo docente, y fortalecer las competencias digitales de los docentes.

Referencias bibliográficas

-

Alvarado García, M. A. (2014). Retroalimentación en educación en línea: una estrategia para la construcción del conocimiento. RIED. Revista Iberoamericana de Educación a Distancia, 17(2), 59-73. https://r.issu.edu.do/bhs

» https://r.issu.edu.do/bhs -

Attiogbe, E. J. K., Oheneba-Sakyi, Y., Kwapong, O. A. T. F., & Boateng, J. (2025). Assessing the relationship between feedback strategies and learning improvement from a distance-learning perspective. Journal of Research in Innovative Teaching & Learning, 18(1), 165-186. https://doi.org/10.1108/JRIT-10-2022-0061

» https://doi.org/10.1108/JRIT-10-2022-0061 -

Ba, S., Yang, L., Yan, Z., Looi, C. K., & Gašević, D. (2025). Unraveling the mechanisms and effectiveness of AI-assisted feedback in education: A systematic literature review. Computers & Education Open, 9, Article 100284. https://doi.org/10.1016/j.caeo.2025.100284

» https://doi.org/10.1016/j.caeo.2025.100284 -

Banihashem, S. K., Noroozi, O., Khosravi, H., Schunn, C. D., & Drachsler, H. (2025). Pedagogical framework for hybrid intelligent feedback. Innovations in Education & Teaching International, 1-17. https://doi.org/10.1080/14703297.2025.2499174

» https://doi.org/10.1080/14703297.2025.2499174 -

Budiman, R. (2025). Teachers’ written feedback in postgraduate online learning: Students’ perspectives. Asian Association of Open Universities Journal, 20(2), 184-195. https://doi.org/10.1108/AAOUJ-01-2025-0015

» https://doi.org/10.1108/AAOUJ-01-2025-0015 -

Campbell, D. T., & Stanley, J. C. (1963). Experimental and quasi-experimental designs for research. En N. L. Gage (Ed.), Handbook of research on teaching (pp. 171-246). Rand McNally. https://r.issu.edu.do/1X

» https://r.issu.edu.do/1X -

CEPAL-UNESCO (2020). La educación en tiempos de la pandemia de COVID-19. Informe COVID-19 (Informe Especial de la CEPAL). CEPAL; UNESCO. https://r.issu.edu.do/l?l=11713nkv

» https://r.issu.edu.do/l?l=11713nkv -

Escobar-Pérez, J., & Cuervo-Martínez, Á. (2008). Validez de contenido y juicio de expertos: Una aproximación a su utilización. Avances en Medición, 6, 27-36. https://r.issu.edu.do/l?l=12521Y4j

» https://r.issu.edu.do/l?l=12521Y4j -

Espasa, A., Guasch, T., Mayordomo, R. M., & Martínez-Melo, M. (2022). Prior experience with online feedback: Its influence on students’ engagement. Distance Education, 43(3), 444-465. https://doi.org/10.1080/01587919.2022.2088480

» https://doi.org/10.1080/01587919.2022.2088480 -

García Riveros, J. M., Farfán Pimentel, J. F., Fuertes Meza, L. C., & Montellanos Solís, A. R. (2021). Evaluación formativa: un reto para el docente en la educación a distancia. Delectus, 4(2), 45-54. https://r.issu.edu.do/W79y

» https://r.issu.edu.do/W79y -

Hattie, J., & Timperley, H. (2007). The power of feedback. Review of Educational Research, 77(1), 81-112. https://doi.org/10.3102/003465430298487

» https://doi.org/10.3102/003465430298487 -

Hernández, R., Fernández, C., & Baptista, P. (2014). Metodología de la investigación (6.ª ed.). McGraw-Hill. https://r.issu.edu.do/w97

» https://r.issu.edu.do/w97 -

Huayhua Prada, M. F., Ávila Zamudio, C. P., Vargas Pacherres, Y. C., & Buitron Bruno, C. R. (2021). La retroalimentación formativa una práctica eficaz en tiempos de pandemia. Horizontes. Revista de Investigación en Ciencias de la Educación, 5(21), 1480-1490. https://r.issu.edu.do/FA6

» https://r.issu.edu.do/FA6 -

Jarrahi, M. H., Lutz, C., & Newlands, G. (2022). Artificial intelligence, human intelligence and hybrid intelligence based on mutual augmentation. Big Data & Society, 9(2). https://doi.org/10.1177/20539517221142824

» https://doi.org/10.1177/20539517221142824 -

Kasneci, E., Sessler, K., Küchemann, S., Bannert, M., Dementieva, D., Fischer, F., Gasser, U., Groh, G., Günnemann, S., Hüllermeier, E., Krusche, S., Kutyniok, G., Michaeli, T., Nerdel, C., Pfeffer, J., Poquet, O., Sailer, M., Schmidt, A., Seidel, T., Stadler, M., Weller, J., Kuhn, J., & Kasneci, G. (2023). ChatGPT for Good? On opportunities and challenges of large language models for education. Learning and Individual Differences, 103, 102274. https://doi.org/10.1016/j.lindif.2023.102274

» https://doi.org/10.1016/j.lindif.2023.102274 -

Keegan, D. (2013). Foundations of distance education. Routledge. https://doi.org/10.4324/9781315004822

» https://doi.org/10.4324/9781315004822 -

Kohnke, L., Moorhouse, B. L., & Zou, D. (2023). Exploring generative artificial intelligence preparedness among university language instructors: A case study. Computers and Education: Artificial Intelligence, 5, 100156. https://doi.org/10.1016/j.caeai.2023.100156

» https://doi.org/10.1016/j.caeai.2023.100156 -

Kong, X., Fang, H., Chen, W., Xiao, J., & Zhang, M. (2025). Examining human-AI collaboration in hybrid intelligence learning environments: Insight from the Synergy Degree Model. Humanities & Social Sciences Communications, 12, 821. https://doi.org/10.1057/s41599-025-05097-z

» https://doi.org/10.1057/s41599-025-05097-z -

Kotlyar, I., Tal, A., & Moorhouse, B. L. (2025). Student reactions to AI versus human feedback in teamwork skills assessment. Int J Educ Technol High Educ, 22, 57. https://doi.org/10.1186/s41239-025-00555-9

» https://doi.org/10.1186/s41239-025-00555-9 -

Lo, N., Chan, S., & Wong, A. (2025). Evaluating teacher, AI, and hybrid feedback in English language learning: Impact on student motivation, quality, and performance in Hong Kong. SAGE Open, 15(3). https://doi.org/10.1177/21582440251352907

» https://doi.org/10.1177/21582440251352907 -

Lozano, F., & Tamez, L. (2014). Retroalimentación formativa para estudiantes de educación a distancia. Revista Iberoamericana de Educación a Distancia, 17(2), 197-221. https://r.issu.edu.do/SH

» https://r.issu.edu.do/SH -

McMillan, J. H., & Schumacher, S. (2005). Investigación educativa: una introducción conceptual (5.ª ed.). Pearson Educación. https://r.issu.edu.do/nNI

» https://r.issu.edu.do/nNI -

Nicol, D., & MacFarlane-Dick, D. (2006). Formative assessment and selfregulated learning: A model and seven principles of good feedback practice. Studies in Higher Education, 31(2), 199-218. https://doi.org/10.1080/03075070600572090

» https://doi.org/10.1080/03075070600572090 -

Öztürk, M., Yüce, E., & Mıhcı Türker, P. (2025). Online Peer Feedback Versus Online Teacher Feedback? Effect of Online Feedback on Students’ Self-Regulated Learning. Tech Know Learn, 30, 769-787. https://doi.org/10.1007/s10758-024-09812-8

» https://doi.org/10.1007/s10758-024-09812-8 -

Pentucci, M., & Laici, C. (2023). Feedback strategies in distance education: A survey of university students. Research on Education and Media, 15(2), 34-40. https://doi.org/10.2478/rem-2023-0022

» https://doi.org/10.2478/rem-2023-0022 -

Shute, V. J. (2008). Focus on Formative Feedback. Review of Educational Research, 78(1), 153-189. https://doi.org/10.3102/0034654307313795

» https://doi.org/10.3102/0034654307313795 -

Singh, S. V., & Hiran, K. K. (2022). The impact of AI on teaching and learning in higher education technology. Journal of Higher Education Theory and Practice, 22(13), 135-148. https://doi.org/10.33423/jhetp.v22i13.5514

» https://doi.org/10.33423/jhetp.v22i13.5514 -

Wang, L., Chen, X., Wang, C., Xu, L., Shadiev, R., & Li, Y. (2024). ChatGPT’s capabilities in providing feedback on undergraduate students’ argumentation: A case study. Thinking Skills & Creativity, 51, 101440. https://doi.org/10.1016/j.tsc.2023.101440

» https://doi.org/10.1016/j.tsc.2023.101440 -

Wiliam, D. (2011). Embedded formative assessment. Solution Tree Press. https://r.issu.edu.do/hPH

» https://r.issu.edu.do/hPH -

Yan, L., Sha, L., Zhao, L., Li, Y., Martinez-Maldonado, R., Chen, G., Li, X., & Jin, Y. (2023). Practical and ethical challenges of large language models in education: A systematic scoping review. Educational Technology Research and Development, 55(1), 90-112. https://doi.org/10.1111/bjet.13370

» https://doi.org/10.1111/bjet.13370 -

Yin, J., Xu, H., Pan, Y., & Hu, Y. (2025). Effects of different AIdriven chatbot feedback on learning outcomes and brain activity. npj Science of Learning, 10(17). https://doi.org/10.1038/s41539-025-00311-8

» https://doi.org/10.1038/s41539-025-00311-8

Retroalimentación efectiva generada por inteligencia híbrida (IA/humana) en educación a distancia

Retroalimentación efectiva generada por inteligencia híbrida (IA/humana) en educación a distancia

Traducido de Artificial intelligence, human intelligence and hybrid intelligence based on mutual augmentation publicado en 2022 en Big Data & Society, 9(2)

Traducido de Artificial intelligence, human intelligence and hybrid intelligence based on mutual augmentation publicado en 2022 en Big Data & Society, 9(2)